Dans les collectivités, plus l’IA automatise certaines tâches, plus l’organisation doit renforcer le dialogue sur le sens du travail, la problématique de l’effort et de l’engagement au travail. Pour un projet IA, cela signifie qu’il ne suffit pas de viser l’efficacité technique, mais qu’il faut aussi prendre en compte la dimension éthique, sociale et émancipatrice de l’innovation.

Habermas rappelle la nécessité de maîtriser « collectivement la technique » pour éviter qu’elle ne devienne une force autonome échappant au contrôle humain. Autrement dit, il est nécessaire que toute l’équipe comprenne concrètement comment cela fonctionne et pas uniquement quelques-uns.

Dans un projet IA, cela implique de favoriser la transparence, de monter en compétences pour tous les membres de l’équipe, et d’ouvrir le dialogue sur les freins à l’usage.

Ce que cela signifie dans la gouvernance des projets IA

Autrement dit, dans un projet IA, il est important de veiller à :

-Organiser des espaces de discussion sur les finalités et les impacts sociaux de l’IA.

-Encourager la réflexion critique sur les biais, les risques et les limites de la technologie.

-Valoriser la transparence dans les choix techniques et les usages des données.

-Intégrer des perspectives pluridisciplinaires (éthique, droit, sciences sociales) pour enrichir le projet.

Rappelons que le taux d’échecs des projets IA est estimé à 85%. cause majeure : mauvaise analyse du besoin.

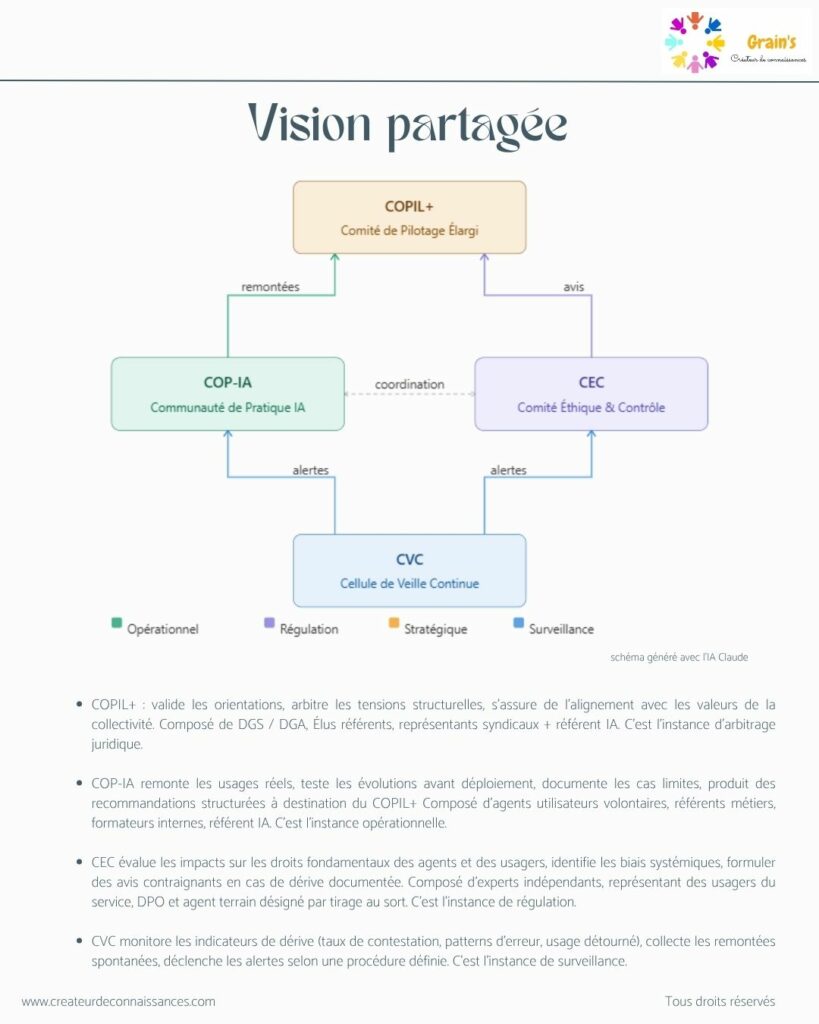

En s’appuyant sur les clefs de l’organisation apprenante, il s’agit d’organiser un pilotage avec plusieurs comités

- COPIL+ : valide les orientations, arbitre les tensions structurelles, s’assure de l’alignement avec les valeurs de la collectivité. Composé de DGS / DGA, Élus référents, représentants syndicaux + référent IA. C’est l’instance d’arbitrage juridique.

- COP-IA remonte les usages réels, teste les évolutions avant déploiement, documente les cas limites, produit des recommandations structurées à destination du COPIL+ Composé d’agents utilisateurs volontaires, référents métiers, formateurs internes, référent IA. C’est l’instance opérationnelle.

- CEC évalue les impacts sur les droits fondamentaux des agents et des usagers, identifie les biais systémiques, formuler des avis contraignants en cas de dérive documentée. Composé d’experts indépendants, représentant des usagers du service, DPO et agent terrain désigné par tirage au sort. C’est l’instance de régulation.

- CVC monitore les indicateurs de dérive (taux de contestation, patterns d’erreur, usage détourné), collecte les remontées spontanées, déclenche les alertes selon une procédure définie. C’est l’instance de surveillance.