À l’ère de l’IA, beaucoup d’organisations raisonnent encore comme si l’enjeu principal était la vitesse : automatiser vite, mesurer vite, rentabiliser vite. Cette logique est compréhensible, parce que l’IA est souvent vendue comme un levier de productivité immédiate. Mais elle devient risquée dès qu’elle fait oublier une réalité simple : une technologie ne transforme pas une organisation à elle seule, elle doit être appropriée, testée, régulée et révisée dans le temps.

Pour un dirigeant, cela change tout.

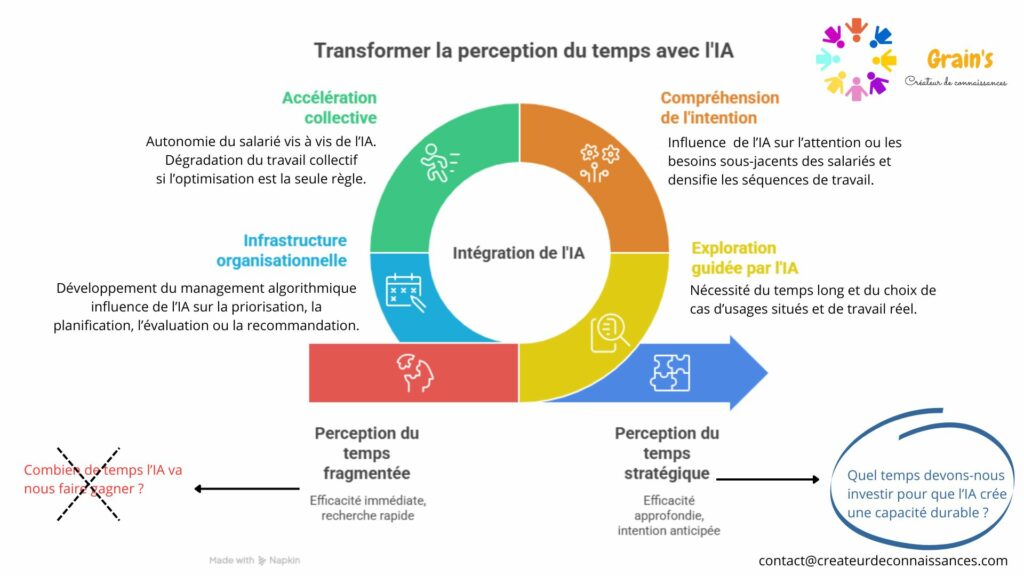

Le sujet n’est pas seulement de “déployer un outil”, mais de construire les conditions d’un apprentissage organisationnel durable. Sans ce temps d’appropriation, les usages restent superficiels, les gains sont instables et les effets pervers apparaissent plus vite que les bénéfices.

L’IA n’échoue pas seulement quand elle est mal choisie ; elle échoue aussi quand on lui demande d’aller plus vite que la capacité humaine et collective à la comprendre.

Pourquoi il faut du temps

Il faut du temps pour explorer la pertinence d’un changement technique, parce qu’un cas d’usage pertinent sur le papier peut se révéler faible dans le travail réel. Il faut du temps pour tester en situation, parce que les écarts entre l’interface, le processus formel et l’activité concrète sont souvent importants.

Il faut du temps enfin pour construire des règles communes, parce que l’IA reconfigure les rôles, les responsabilités, les arbitrages et la circulation de l’information.

Autrement dit, l’intégration de l’IA n’est pas un événement ponctuel, c’est un processus.

Les dirigeants qui réussissent cette transformation ne sont pas ceux qui “font vite”, mais ceux qui savent organiser un cycle d’expérimentation, de retour d’expérience, d’ajustement et de montée en puissance.

Le temps long devient alors un actif stratégique, pas une lenteur administrative.

Ce que le court-termisme abîme

orsqu’une organisation impose une logique de rendement immédiat, plusieurs dimensions du travail se fragilisent. L’autonomie du salarié peut diminuer si l’IA devient une béquille sans apprentissage réel. Le travail collectif peut se dégrader si l’outil pousse chacun à optimiser sa propre tâche sans voir les interdépendances. L’expertise peut s’appauvrir si l’on délègue trop tôt à la machine des décisions que les équipes ne prennent plus le temps d’examiner.

Le risque est plus profond qu’une simple perte de confort.

À terme, l’organisation peut perdre sa capacité à comprendre son propre fonctionnement. Si l’IA automatise sans apprentissage, elle crée une dépendance technique et une fragilité managériale.

On croit gagner du temps, mais on perd de la maîtrise.

L’IA transforme aussi le temps de travail

Les effets de l’IA sur le temps de travail sont hétérogènes. Dans certains contextes, elle allège des tâches répétitives et libère du temps pour des activités à plus forte valeur ajoutée. Dans d’autres, elle élargit le périmètre du travail, augmente les sollicitations, accélère les cadences et brouille la frontière entre temps professionnel et temps personnel.

C’est un point décisif pour les managers : l’IA n’agit pas seulement sur la quantité de temps, mais sur sa qualité. Elle peut fragmenter l’attention, multiplier les micro-décisions et créer une impression de disponibilité permanente.

Dès lors, piloter l’IA, ce n’est pas seulement suivre des gains de productivité ; c’est aussi protéger des temps de concentration, des temps de coordination et des temps d’apprentissage.

Trois leviers de gouvernance

Le premier levier est l’ergonomie du travail réel. Il faut partir des situations concrètes, pas des promesses du fournisseur. Quels problèmes l’IA résout-elle réellement ? Quelles tâches accélère-t-elle ? Quelles autres tâches déplace-t-elle vers les équipes ? Cette approche oblige à regarder l’activité telle qu’elle se fait, et non telle qu’elle est décrite dans les procédures.

Le deuxième levier est l’apprentissage organisationnel. Une IA utile n’est pas seulement un outil performant, c’est un outil qu’on sait apprendre à utiliser collectivement. Cela suppose des temps de retour d’expérience, des ajustements de règles, des formations situées et des espaces où l’on peut discuter des erreurs sans les dramatiser. L’organisation devient plus robuste quand elle accepte que l’IA est aussi un objet d’apprentissage.

Le troisième levier est la gouvernance du management algorithmique. Dès qu’une IA influence la priorisation, la planification, l’évaluation ou la recommandation, elle devient un acteur de l’organisation. Il faut alors définir des limites, expliciter qui décide, préserver des marges de jugement humain et organiser des contre-pouvoirs. Sans cela, l’IA finit par imposer son propre tempo au lieu de servir celui de l’organisation.

Ce que montre l’exemple Google sur le marché de l’IA.

Le cas Google illustre bien cette reconfiguration du temps.

Le cas Google montre aussi une tension forte. D’un côté, l’entreprise promet une expérience utilisateur plus fluide et plus intelligente. De l’autre, elle internalise une logique d’accélération intense, avec une pression forte sur les équipes pour aller plus vite et travailler davantage.

Cela révèle une vérité importante : à l’ère de l’IA, les organisations parlent volontiers du temps qu’elles font gagner aux autres, mais elles rappellent aussi que le temps, c’est de l’argent…

Ce que les dirigeants doivent retenir

Le bon réflexe n’est pas de demander uniquement “combien de temps l’IA va nous faire gagner ?”. La vraie question est : quel temps devons-nous investir pour que l’IA crée une capacité durable ? Temps d’analyse, temps d’expérimentation, temps de formation, temps de régulation, temps de discussion entre métiers, temps de supervision.

Une direction qui néglige cette question risque trois erreurs. Elle peut choisir de mauvais cas d’usage parce qu’elle a confondu rapidité et pertinence. Elle peut fragiliser les équipes en accélérant sans cadre. Elle peut enfin créer une dépendance technique qui rend l’organisation plus performante à court terme mais moins adaptable à moyen terme.

En pratique, les bons leviers sont donc simples à formuler, même s’ils demandent de la discipline : partir du travail réel, intégrer les équipes dès le départ, piloter l’IA comme un processus d’apprentissage, et poser des règles claires sur ce qui peut être automatisé et ce qui doit rester sous jugement humain.

C’est à cette condition que l’IA devient un appui à la décision et non une machine à accélérer le désordre.

A lire : Travaux de Laboria sur l’IA capacitante.